Gaza, i dati ONU: solo il 10% degli aiuti è arrivato a destinazione

4 Ottobre 2025

Marquee Moon

4 Ottobre 2025L’esperimento della stanza cinese: può un’intelligenza artificiale davvero comprendere?

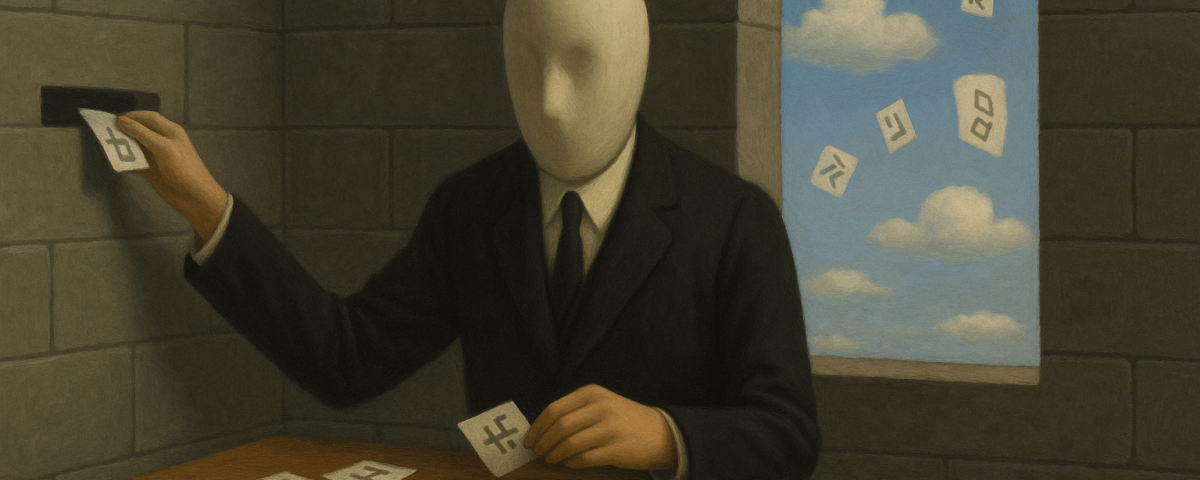

L’esperimento della stanza cinese è uno degli esperimenti mentali più influenti nella filosofia dell’intelligenza artificiale. Formulato dal filosofo John Searle nel 1980, mette in discussione l’idea che una macchina capace di imitare il comportamento linguistico umano possa essere considerata realmente intelligente.

Searle racconta di aver sviluppato questo esperimento mentale dopo aver letto di un programma informatico apparentemente capace di “comprendere” storie. Il programma riceveva un racconto semplice – un uomo che va al ristorante, riceve un hamburger bruciato e se ne va senza pagare – e rispondeva correttamente a domande come “Ha mangiato l’hamburger?”. I ricercatori sostenevano che questo dimostrasse capacità di comprensione simili a quelle umane. Searle non era d’accordo.

Immaginate una persona che non parla cinese, chiusa in una stanza. Questa persona dispone di un manuale con regole precise per rispondere a frasi in cinese, basate esclusivamente sulla sintassi. Dall’esterno, un parlante cinese invia domande in cinese. L’operatore nella stanza applica meccanicamente le regole del manuale e fornisce risposte che, dal punto di vista esterno, appaiono perfettamente sensate e convincenti.

Il parlante cinese all’esterno avrà l’impressione di comunicare con qualcuno che comprende davvero la sua lingua. Ma la realtà è diversa: l’operatore non capisce né le domande né le risposte. Si limita a seguire istruzioni sintattiche senza alcuna comprensione del significato.

Un’intelligenza artificiale sofisticata si trova nella stessa situazione dell’operatore nella stanza. Può manipolare simboli, applicare regole sintattiche ed elaborare risposte apparentemente intelligenti, ma questo non equivale a comprendere.

Come scrive Searle: “Le manipolazioni formali di simboli non hanno in sé alcuna intenzionalità; sono del tutto prive di significato. Nel gergo linguistico, hanno solo una sintassi, ma nessuna semantica. L’intenzionalità che i computer sembrano avere esiste solo nella mente di coloro che li programmano e di coloro che li utilizzano.”

Parlare una lingua non significa solo usare i simboli giusti al momento giusto: richiede una coscienza del loro significato. Il programma è sintattico, non semantico. È un sistema formale privo di contenuti mentali.

L’argomento di Searle si oppone alla tesi che la mente sia semplicemente un programma che “gira” sul cervello. Secondo le teorie funzionaliste, se un programma svolge le stesse funzioni di una mente, non c’è motivo di distinguerli: entrambi sarebbero ugualmente intelligenti.

Per Searle questa analogia è errata. La mente non è una semplice “istanziazione” di funzionalità informatiche. Se elabora informazioni, lo fa in modo radicalmente diverso dal computer. La differenza fondamentale è che la mente produce stati mentali – stati dotati di intenzionalità, cioè diretti verso un contenuto.

Sviluppare programmi sempre più sofisticati, capaci persino di simulare tutte le funzionalità della mente umana (la cosiddetta IA “forte”), non basterà mai a creare una vera mente artificiale. Per questo servirebbe una macchina capace di produrre stati mentali. E finora conosciamo un solo sistema dotato di questo “potere causale”: il cervello biologico.

Come spiega Searle: “Non è perché sono l’istanziazione di un programma informatico che sono capace di comprendere, ma perché sono un organismo dotato di una certa struttura biologica che, in certe condizioni, è causalmente capace di produrre la percezione, l’azione, la comprensione, l’apprendimento e altri fenomeni intenzionali.”

Searle non esclude che altre strutture fisiche e chimiche potrebbero in teoria produrre gli stessi effetti – forse esseri extraterrestri con cervelli di materia diversa potrebbero avere intenzionalità – ma sottolinea che i progressi nella programmazione non ci avvicinano a questo obiettivo.

L’esperimento della stanza cinese ha generato decenni di dibattito filosofico, con innumerevoli argomenti a favore e contro. Ma una cosa è certa: ha profondamente influenzato il modo in cui pensiamo all’intelligenza artificiale, costringendoci a chiederci se simulare l’intelligenza significhi davvero possederla.